Diagnóstico SEO Técnico

Problemas de SEO técnico: los más comunes y cómo solucionarlos

Tu sitio puede tener el mejor contenido del mundo, pero si Google no puede rastrearlo, indexarlo o entenderlo, es como si no existiera. Los problemas técnicos son la causa #1 de sitios invisibles en Google.

Después de cientos de auditorías técnicas, los mismos errores se repiten una y otra vez. Acá los documento todos: qué porcentaje de sitios los tiene, por qué son graves, y cómo corregir cada uno con datos reales.

51%

noindex accidental

69%

páginas sin enlaces internos

35%

velocidad deficiente

50%

robots.txt mal configurado

¿Qué son los problemas técnicos de SEO?

Los problemas técnicos de SEO son errores en la infraestructura de tu sitio web que impiden que los motores de búsqueda puedan rastrearlo, indexarlo y posicionarlo correctamente.

A diferencia del SEO de contenido (keywords, textos) o del link building (autoridad externa), el SEO técnico trabaja los cimientos sobre los que se construye todo. Si la base técnica falla, las demás estrategias pierden efectividad.

La buena noticia: las correcciones técnicas son las más rápidas del SEO. Mientras el contenido puede tardar meses en posicionar, resolver un problema de indexación se refleja en días. Por eso siempre recomiendo empezar por acá.

¿Cómo detectar si tu sitio tiene problemas técnicos?

Las señales de alerta más claras son: páginas que no aparecen en Google (verificá con site:tudominio.com), errores en la sección de Cobertura de Google Search Console, velocidad lenta en PageSpeed Insights, y caídas de tráfico orgánico sin cambios de contenido.

Las herramientas esenciales: Google Search Console (datos directos de Google), Screaming Frog (crawling técnico completo), PageSpeed Insights (velocidad y Core Web Vitals) y Chrome DevTools (debugging en tiempo real).

Problemas de rastreo e indexación

Los más graves. Si Google no puede rastrear o indexar tus páginas, directamente no existen en los resultados de búsqueda. Ninguna otra optimización importa hasta que estos estén resueltos.

Robots.txt mal configurado

CríticaEl archivo robots.txt bloquea páginas que deberían ser rastreadas. Un Disallow: / en producción deja tu sitio invisible para Google. También ocurre cuando se migra desde staging sin limpiar las directivas de bloqueo.

Solución: Revisar robots.txt con la herramienta de prueba de GSC. Verificar que no bloquee /css/, /js/ ni páginas importantes. Enviar sitemap en robots.txt.

50%

de sitios afectados

Directivas noindex accidentales

CríticaPáginas marcadas con <meta name='robots' content='noindex'> que deberían estar indexadas. Común después de migraciones, en entornos de staging que pasan a producción sin limpiar, o en plugins de CMS mal configurados.

Solución: Auditar con Screaming Frog filtrando por directiva noindex. Cruzar con páginas que generan tráfico en GSC. Eliminar noindex donde no corresponda.

51%

de sitios afectados

Sitemap XML desactualizado o ausente

AltaSitemaps que no existen, contienen URLs con errores 404, incluyen páginas con noindex, o no se actualizan cuando se publican nuevas páginas. Google pierde la guía para descubrir tu contenido.

Solución: Generar sitemap dinámico que se actualice con cada deploy. Verificar que solo incluya URLs canónicas con status 200. Enviarlo en GSC.

15%

de sitios afectados

Crawl budget desperdiciado

MediaGoogle tiene un presupuesto de rastreo limitado para tu sitio. Cadenas de redirecciones, páginas de paginación infinita, parámetros de filtrado y URLs con sesión consumen ese presupuesto sin aportar valor.

Solución: Bloquear parámetros innecesarios en robots.txt. Implementar canonical en paginación. Eliminar cadenas de redirecciones (máximo 1 salto).

22%

de sitios afectados

Problemas de velocidad y rendimiento

Google usa los Core Web Vitals como factor de ranking. Un sitio lento pierde posiciones y usuarios. El 35% de sitios auditados tiene velocidad deficiente.

Velocidad de carga

< 2.5s

Interactividad

< 200ms

Estabilidad visual

< 0.1

Core Web Vitals deficientes (LCP, CLS, INP)

AltaLCP mayor a 2.5 segundos, CLS mayor a 0.1, o INP mayor a 200ms. Google usa estas métricas como factor de ranking desde 2021. El 53% de los usuarios móviles abandonan sitios que tardan más de 3 segundos.

Solución: Medir con PageSpeed Insights y el reporte de CWV en GSC. Priorizar LCP (imágenes hero, fonts) > CLS (dimensiones de imágenes, reservar espacio) > INP (reducir JS).

35%

de sitios afectados

CSS y JavaScript sin minificar ni comprimir

AltaArchivos CSS sin minificar afectan al 58% de sitios auditados. JavaScript sin minificar al 50%. Sin compresión gzip/brotli, cada kilobyte extra retrasa la carga y penaliza los Core Web Vitals.

Solución: Implementar minificación en el build pipeline. Habilitar compresión Brotli en el servidor. Diferir JavaScript no crítico con defer/async.

49%

de sitios afectados

Imágenes sin optimizar

AltaImágenes con dimensiones excesivas, sin compresión, en formatos obsoletos (BMP, PNG sin necesidad) o sin lazy loading. Es la causa más común de LCP alto.

Solución: Convertir a WebP/AVIF. Implementar lazy loading nativo. Definir width/height para evitar CLS. Servir tamaños responsivos con srcset.

36%

de sitios afectados

Problemas de contenido duplicado y canonicalización

Cuando Google encuentra el mismo contenido en múltiples URLs, no sabe cuál posicionar. El resultado: ninguna posiciona bien y la autoridad se diluye.

Canonical incorrecto o ausente

AltaEtiquetas rel=canonical apuntando a URLs incorrectas, a páginas 404, o simplemente ausentes. Esto confunde a Google sobre cuál es la versión principal de cada página y diluye la autoridad.

Solución: Auditar canonicals con Screaming Frog. Cada página debe tener canonical autorreferencial o apuntando a la versión preferida. Verificar que no apunten a URLs con redirect.

5%

de sitios afectados

Múltiples versiones del dominio

AltaCoexisten versiones con www y sin www, HTTP y HTTPS, o con trailing slash y sin él. Cada versión es una URL distinta para Google, generando contenido duplicado y diluyendo autoridad entre todas.

Solución: Elegir una versión canónica. Implementar redirecciones 301 de todas las variantes a la versión elegida. Configurar dominio preferido en GSC.

8%

de sitios afectados

Canibalización de contenidos

MediaVarias páginas del mismo sitio compiten por la misma keyword. Google no sabe cuál posicionar y termina posicionando ninguna bien. Frecuente en blogs con artículos que cubren temas similares sin estrategia de keyword mapping.

Solución: Mapear cada keyword a una sola URL. Consolidar contenido duplicado con 301 redirects. Usar canonical cuando no se pueda eliminar la duplicación.

5%

de sitios afectados

Hreflang mal implementado

MediaEn sitios multiidioma, errores en hreflang hacen que Google muestre la versión en inglés a usuarios en español, o viceversa. Errores comunes: falta de return tags, códigos de idioma incorrectos, hreflang apuntando a URLs no canónicas.

Solución: Verificar implementación con hreflang audit de Screaming Frog. Cada hreflang debe tener return tag. Usar códigos ISO 639-1 correctos.

10%

de sitios afectados

Problemas de enlazado interno

Los enlaces internos son las rutas que Googlebot sigue para descubrir tu contenido. Si están rotos, llevan a redirecciones, o simplemente no existen, Google no puede navegar tu sitio eficientemente.

Enlaces rotos internos (404)

AltaLinks que apuntan a páginas que ya no existen. Cada enlace roto es una ruta muerta para Googlebot y una mala experiencia para el usuario. Comunes después de eliminar páginas o cambiar URLs sin implementar redirects.

Solución: Crawlear el sitio con Screaming Frog filtrando respuestas 4XX. Corregir con 301 redirects o actualizar los links a las URLs correctas.

36%

de sitios afectados

Cadenas de redirecciones

MediaURL A redirige a B, que redirige a C, que redirige a D. Cada salto consume crawl budget, diluye link equity y aumenta el tiempo de carga. Google deja de seguir cadenas después de aproximadamente 5 saltos.

Solución: Identificar cadenas con Screaming Frog (Redirect Chains report). Actualizar cada redirect para apuntar directamente al destino final.

22%

de sitios afectados

Páginas huérfanas (orphan pages)

AltaPáginas que no reciben ningún enlace interno. Si ninguna página de tu sitio enlaza a ellas, Google las descubre solo por sitemap (si están incluidas). El 69% de sitios tiene páginas sin enlaces internos entrantes según datos de auditorías masivas.

Solución: Identificar orphan pages cruzando sitemap con crawl. Agregar enlaces internos desde páginas temáticamente relevantes. Evaluar si las páginas huérfanas deben existir.

69%

de sitios afectados

Texto ancla no descriptivo

MediaEnlaces con texto genérico como 'clic aquí', 'leer más' o directamente la URL desnuda. El texto ancla ayuda a Google a entender el contexto de la página enlazada. Anclas no descriptivas desperdician esa señal.

Solución: Auditar textos ancla con Screaming Frog. Reescribir con textos descriptivos que incluyan la keyword target de la página destino.

68%

de sitios afectados

Problemas de on-page técnico

Errores en meta tags, imágenes, datos estructurados y adaptación móvil. Menos graves que los de rastreo, pero afectan el CTR, la accesibilidad y la visibilidad en la SERP.

Alt text faltante en imágenes

MediaEs el error SEO más frecuente: 3 de cada 4 sitios tienen imágenes sin atributo alt. El alt text ayuda a Google a entender las imágenes, mejora la accesibilidad y es requisito para aparecer en Google Images.

Solución: Auditar imágenes sin alt. Añadir descripciones útiles y contextuales. Incluir keywords donde sea natural, sin keyword stuffing.

74%

de sitios afectados

Meta descriptions ausentes o duplicadas

MediaEl 65% de sitios no tiene meta description en alguna de sus páginas. Y el 50% tiene descriptions duplicadas entre diferentes URLs. Sin meta description, Google genera un snippet automático que rara vez es óptimo para el CTR.

Solución: Escribir meta descriptions únicas para cada página importante. Máximo 155 caracteres. Incluir la keyword principal y un call-to-action.

65%

de sitios afectados

Títulos demasiado largos, cortos o duplicados

MediaTítulos de más de 60 caracteres se cortan en la SERP. Títulos muy cortos no describen la página. Títulos duplicados entre URLs confunden a Google. El 54% de sitios tiene títulos duplicados.

Solución: Title tags de 30-60 caracteres. Keyword principal al inicio. Cada página con título único. Auditar con Screaming Frog > Page Titles.

68%

de sitios afectados

Datos estructurados ausentes o con errores

MediaSchema markup faltante o mal implementado. Los datos estructurados habilitan rich snippets (FAQ, review stars, breadcrumbs) que aumentan el CTR. Sin ellos, tu resultado en la SERP es texto plano mientras la competencia destaca visualmente.

Solución: Implementar schema JSON-LD relevante: Article, FAQPage, HowTo, LocalBusiness, Product. Validar con Rich Results Test de Google.

40%

de sitios afectados

Falta de diseño responsive / mobile-first

AltaGoogle usa mobile-first indexing: la versión móvil de tu sitio es la que se indexa. Si tu web no se adapta a móviles, perdes posiciones directamente. Incluye textos ilegibles, botones muy pequeños y contenido que se sale del viewport.

Solución: Implementar diseño responsive. Testear con Mobile-Friendly Test de Google. Verificar que el contenido sea idéntico en móvil y desktop.

15%

de sitios afectados

Problemas de seguridad

Sitio sin HTTPS

CríticaGoogle Chrome muestra advertencia 'No seguro' en sitios HTTP. Es factor de ranking confirmado desde 2014. Los usuarios abandonan inmediatamente al ver la advertencia, especialmente en páginas con formularios o datos sensibles.

Solución: Instalar certificado SSL (Let's Encrypt es gratuito). Redirigir todo HTTP a HTTPS con 301. Actualizar enlaces internos y canonical a HTTPS.

5%

de sitios afectados

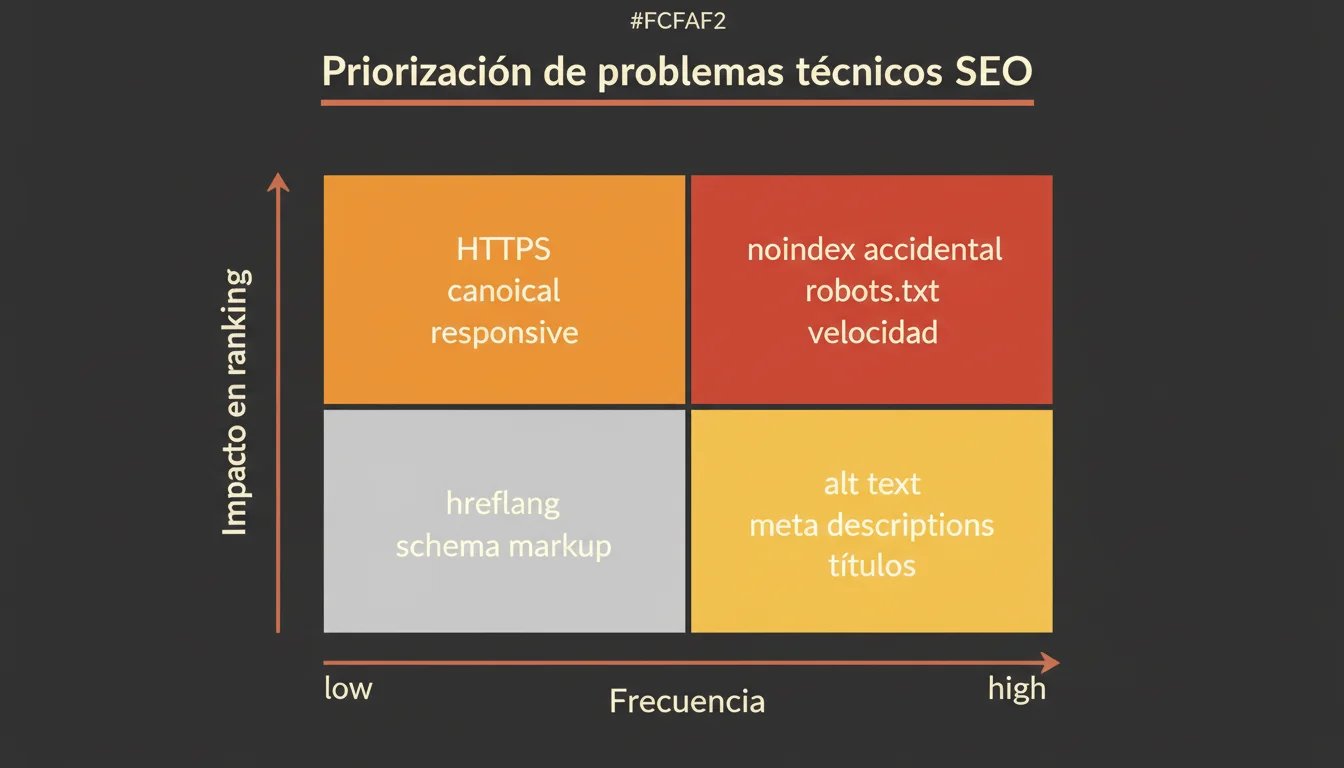

Cómo priorizar qué problemas resolver primero

No todos los errores pesan igual. Este es el proceso para identificar, priorizar y resolver problemas técnicos en orden de impacto real.

Diagnóstico

Identificar los problemas técnicos con Google Search Console, Screaming Frog y PageSpeed Insights. Los datos de GSC vienen directo de Google, no de estimaciones de terceros.

Priorización por impacto

No todos los errores pesan igual. Problemas de indexación bloquean páginas enteras; un alt text faltante es cosmético. Priorizar por impacto real en tráfico orgánico.

Corrección y validación

Implementar correcciones y verificar en Search Console que Google las procese. Usar la inspección de URLs para confirmar que los cambios se reflejan.

Monitoreo continuo

Los problemas técnicos reaparecen con cada deploy o actualización de plugin. Alertas automáticas detectan anomalías antes de que afecten el tráfico.

Regla de priorización

Resolver inmediatamente. Problemas de indexación (noindex, robots.txt) y HTTPS. Bloquean páginas enteras de aparecer en Google.

Resolver esta semana. Velocidad, enlaces rotos, canonical, responsive. Impactan directamente el ranking y la experiencia del usuario.

Planificar este mes. Alt text, meta descriptions, texto ancla, schema markup. Mejoran CTR y señales complementarias.

Caso de éxito: problemas técnicos resueltos, resultados reales

x12

Crecimiento en páginas indexadas para ecommerce de recambios de auto

Un ecommerce con más de 300.000 productos donde Google solo indexaba una fracción del catálogo. Los problemas técnicos eran la causa directa de la baja visibilidad orgánica:

25K → 301K

Páginas indexadas

+72,7%

Keywords Top 10

+305%

Productos vendidos

+560K€

Facturación adicional

Problemas técnicos resueltos:

- ✓ Sitemaps segmentados para indexación masiva de +300K productos

- ✓ Canonicalización correcta de URLs duplicadas por parámetros de filtro

- ✓ Arquitectura de enlaces internos reestructurada por categorías

- ✓ Optimización de velocidad: compresión de imágenes, lazy loading, CDN

Herramientas para detectar problemas técnicos de SEO

Combino herramientas profesionales de la industria con scripts propios en Python para análisis que van más allá de lo estándar.

Preguntas frecuentes sobre problemas de SEO técnico

¿Qué son los problemas técnicos de SEO?

Los problemas técnicos de SEO son errores en la infraestructura de tu sitio web que impiden que Google lo rastree, indexe o posicione correctamente. Incluyen errores de rastreo (robots.txt mal configurado, noindex accidental), velocidad lenta (Core Web Vitals deficientes), contenido duplicado (canonical incorrecto), enlaces rotos, y problemas on-page (meta tags ausentes, falta de HTTPS). Son la base técnica que debe estar resuelta antes de invertir en contenido o link building.

¿Cuáles son los errores técnicos SEO más comunes?

Según datos de auditorías masivas, los más frecuentes son: imágenes sin alt text (74% de sitios), páginas sin enlaces internos entrantes (69%), meta descriptions ausentes (65%), títulos con longitud incorrecta (68%), archivos CSS/JS sin minificar (50-58%), y problemas de velocidad de carga (35%). Los más graves, aunque menos frecuentes, son los problemas de indexación: noindex accidental y robots.txt mal configurado.

¿Cómo sé si mi sitio tiene problemas técnicos de SEO?

Las señales más claras son: páginas que no aparecen en Google (busca site:tudominio.com), errores en Google Search Console (cobertura, Core Web Vitals), velocidad lenta en PageSpeed Insights (score menor a 50), y caídas de tráfico orgánico sin cambios de contenido. Una auditoría técnica con Screaming Frog y Google Search Console revela todos los problemas.

¿Cuánto tarda en verse resultados al corregir problemas técnicos?

Los cambios técnicos son los más rápidos del SEO. La indexación de páginas puede verse en 24-72 horas. Correcciones de errores de rastreo se reflejan en días. Mejoras de velocidad impactan inmediatamente en la experiencia del usuario. A diferencia del SEO de contenido que puede tardar meses, el técnico muestra resultados en semanas.

¿Qué son los Core Web Vitals?

Son métricas de Google que miden la experiencia del usuario: LCP (Largest Contentful Paint) mide velocidad de carga, INP (Interaction to Next Paint) mide interactividad, y CLS (Cumulative Layout Shift) mide estabilidad visual. Son factores de ranking desde 2021. Los umbrales óptimos son: LCP menor a 2.5s, INP menor a 200ms, CLS menor a 0.1.

¿Qué es el crawl budget y por qué importa?

El crawl budget es la cantidad de páginas que Googlebot rastrea en tu sitio en un período determinado. Para sitios pequeños no es crítico, pero para sitios con miles de páginas (ecommerce, directorios), optimizar el crawl budget asegura que Google priorice las páginas importantes y no desperdicie recursos en URLs irrelevantes como parámetros de filtrado o paginación infinita.

¿Qué herramientas necesito para detectar problemas técnicos de SEO?

Las esenciales son: Google Search Console (datos directos de Google sobre rastreo, indexación y Core Web Vitals), Screaming Frog (crawling técnico completo del sitio), PageSpeed Insights (análisis de velocidad y Core Web Vitals por página), y Chrome DevTools (debugging en tiempo real). Para sitios grandes, se complementa con análisis de logs de servidor y automatización con Python.

¿Necesito un consultor SEO para resolver problemas técnicos?

Depende de la complejidad. Errores simples como alt text faltante o meta descriptions se corrigen internamente. Pero problemas de indexación masiva, migraciones, crawl budget o arquitectura web requieren experiencia técnica. Un consultor SEO identifica qué priorizar y evita que las correcciones generen nuevos problemas. Si tu sitio tiene miles de páginas o ha perdido tráfico sin explicación, vale la pena una auditoría profesional.

Artículos relacionados

Velocidad Web y SEO: Cómo Optimizar Core Web Vitals

Aprende a optimizar Core Web Vitals (LCP, CLS, INP) para mejorar tu posicionamiento web. Guía práctica con herramientas y técnicas para acelerar tu sitio.

SEOChecklist SEO: Lista de Verificación Completa para tu Sitio

La checklist SEO definitiva con +40 puntos organizados por categoría: técnico, on-page, contenido y off-page. Lista práctica para auditar y optimizar tu sitio web.

SEO10 Errores SEO Comunes y Cómo Evitarlos

Los errores de SEO más frecuentes que encuentro en auditorías reales: problemas técnicos, de contenido y estrategia que frenan tu posicionamiento web.

¿Tu sitio tiene problemas técnicos que frenan tu SEO?

Una auditoría SEO profesional identifica exactamente qué está impidiendo que Google indexe y posicione tu sitio correctamente. Sin suposiciones, con datos de Search Console y crawling técnico.